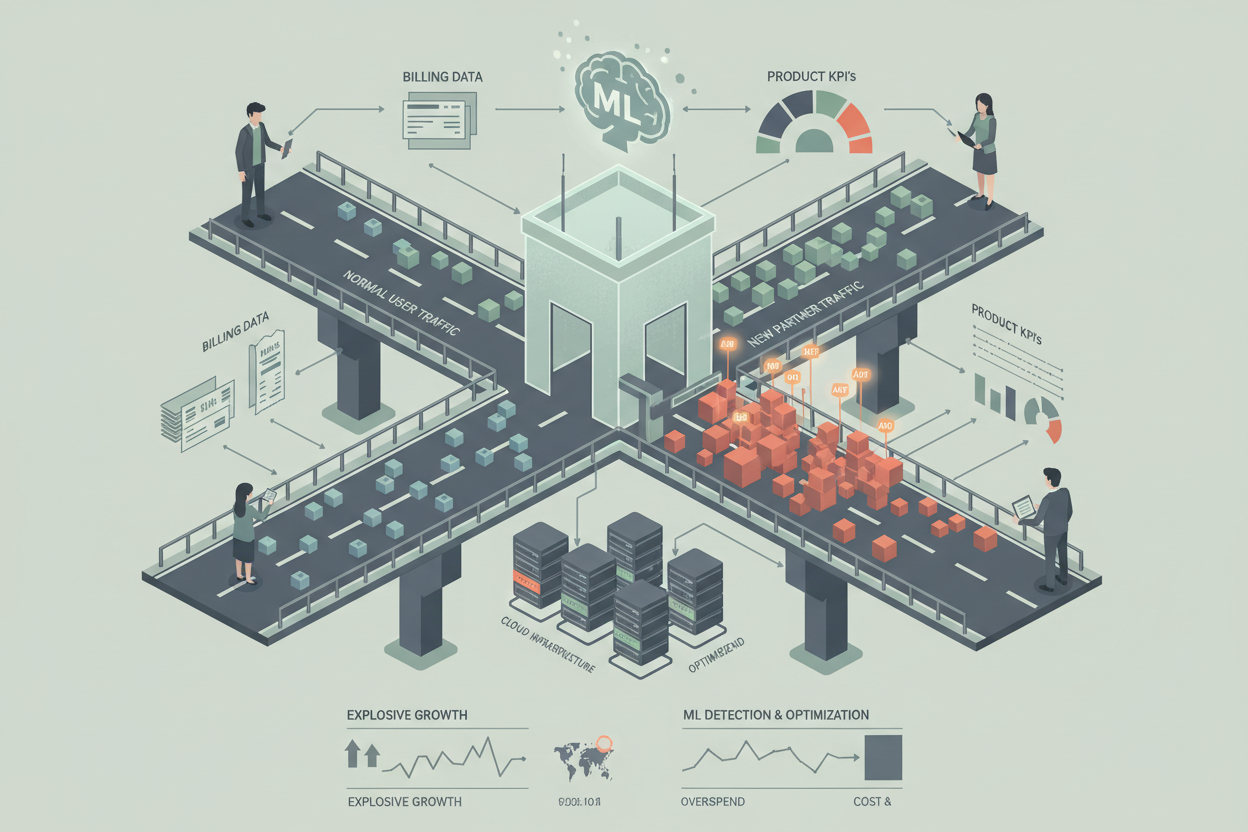

В мире SaaS, где рост зачастую происходит экспоненциально, быстрое масштабирование cloud-инфраструктуры может привести к неожиданным edge-cases в биллинге и аналитике KPI. Рассмотрим, как построить ML-ready архитектуру, которая позволит не только обнаруживать, но и предотвращать подобные инциденты, а также оптимизировать затраты и roadmap.

Хронология инцидента: Взрывной рост и неожиданные расходы

Компания X, предоставляющая SaaS-платформу для анализа данных, столкнулась с резким ростом пользовательской базы. Инфраструктура в облаке масштабировалась автоматически, чтобы справиться с нагрузкой. Однако, спустя месяц, команда финансов обнаружила аномальный рост расходов на облачные сервисы, не соответствующий ожидаемому увеличению ARPU (Average Revenue Per User).

Момент детекта: Алерт от ML-модели

К счастью, в компании X была развернута ML-модель, обученная на исторических данных о потреблении ресурсов и их стоимости. Модель обнаружила отклонение текущих расходов от прогнозируемых, сгенерировав алерт в системе мониторинга. Этот алерт позволил оперативно начать расследование.

Реконструкция geo-трейса: Поиск корневой причины

Анализ данных показал, что основной причиной перерасхода стали вычислительные ресурсы, используемые для обработки запросов пользователей в определенном географическом регионе. При дальнейшем изучении выяснилось, что: запросы атипичные, объёмы существенно выше, чем у других пользователей, использование ресурсов процессора выше. Было принято решение провести geo-трейс активности, чтобы понять, откуда поступают эти запросы. Позже выяснилось, что новый партнер, привлекший большое количество пользователей из этого региона, использовал платформу не по назначению, генерируя большое количество неоптимизированных запросов, что спровоцировало рост вычислительных затрат.

Релиз фикса: Policy-Driven ограничение

Для оперативного решения проблемы были предприняты следующие шаги:

- Временно ограничено количество запросов от партнерского аккаунта, для минимизации нагрузки и расходов.

- Развернута оптимизированная версия API, с более эффективной обработкой запросов (по времени отклика, например) из данного региона.

- В Policy-Driven API Gateway были добавлены правила, ограничивающие потребление ресурсов для партнерского аккаунта, основываясь на его тарифном плане, как описано в статье Playbook миграции API Gateway на Policy-Driven маршрутизацию для B2B.

Долгосрочные меры: ML-driven адаптация API и биллинга

Для предотвращения подобных ситуаций в будущем, компания X внедрила следующие долгосрочные меры:

- Разработка ML-модели, которая в реальном времени анализирует паттерны использования платформы и автоматически адаптирует лимиты потребления ресурсов для каждого аккаунта. Модель обучена не только на объеме данных, но и на сложности запросов, геолокации пользователей и других факторах.

- Внедрение тарификации, учитывающей вычислительную сложность запросов. Например, вместо фиксированной цены за запрос введена переменная, зависящая от объема потребляемых ресурсов.

- Использование High-Performance Caching Strategies, которые описаны в данной статье, для тех запросов, которые повторяются часто.

Уроки: ML как инструмент compliance и оптимизации

Этот инцидент показал, что ML может быть не только инструментом для улучшения качества сервиса, но и важной частью compliance-архитектуры, обеспечивающей прозрачность и контролируемость затрат.

Чек-лист ML-ready архитектуры для SaaS

- Внедрите систему мониторинга и алертинга, основанную на ML: Модель должна анализировать исторические данные о потреблении ресурсов, прогнозировать будущие затраты и генерировать алерты при отклонениях от прогноза.

- Обеспечьте прозрачность данных биллинга: Предоставьте командам финансов и разработки доступ к детальной информации о потреблении ресурсов, включая данные о геолокации пользователей, типах запросов и т.д.

- Автоматизируйте адаптацию лимитов потребления ресурсов: Разработайте ML-модель, которая в реальном времени анализирует паттерны использования платформы и автоматически адаптирует лимиты потребления ресурсов для каждого аккаунта, основываясь на тарифном плане и других факторах.

- Внедрите тарификацию, учитывающую сложность запросов: Вместо фиксированной цены за запрос введите переменную, зависящую от объема потребляемых ресурсов (вычислительная сложность, объем передаваемых данных и т.д.).

- Используйте Policy-Driven API Gateway: Внедрение API Gateway позволяет гибко управлять доступом к ресурсам и контролировать потребление ресурсов, основываясь на правилах и политиках.

- Проводите регулярные аудиты безопасности и compliance: Регулярно оценивайте архитектуру и процессы биллинга на предмет соответствия требованиям безопасности и compliance.

Внедрение ML-ready архитектуры – это инвестиция в долгосрочную стабильность и прибыльность вашего SaaS-бизнеса. Хотите оптимизировать свою SaaS-платформу? Обратитесь к нашим специалистам, чтобы получить консультацию и индивидуальную стратегию.